19/1/2026

L'IA nel Mondo del Lavoro: Linee Guida Ministeriali e Legge 132/2025

Tra rivoluzione tecnologica e sfide etiche, l'Italia traccia la rotta dell'IA nel lavoro con la Legge 132/2025 e le nuove linee guida ministeriali, ponendo al centro i diritti fondamentali.

L'avvento dell'Intelligenza Artificiale (IA) nei processi produttivi e organizzativi rappresenta la più significativa discontinuità tecnologica degli ultimi decenni, equiparabile per impatto alla rivoluzione industriale o all'avvento di Internet. Tuttavia, a differenza delle precedenti ondate di innovazione, l'IA pone interrogativi inediti che travalicano la mera efficienza economica, toccando le corde profonde dell'etica, della dignità umana e dei diritti fondamentali. In questo scenario, l'Italia si è posizionata come pioniere normativo attraverso l'approvazione della Legge 23 settembre 2025, n. 132 e la successiva adozione del Decreto Ministeriale n. 180 del 17 dicembre 2025, recante le "Linee guida per l'implementazione dell'Intelligenza Artificiale nel mondo del lavoro".

Il Nuovo Ecosistema Normativo Italiano

Genesi e Contesto: Dalla Strategia Europea alla Legge Nazionale

La regolamentazione italiana dell'IA non nasce in un vuoto pneumatico, ma è il frutto di un complesso dialogo tra le istanze sovranazionali e le specificità del diritto del lavoro nazionale. Il punto di partenza è ineludibilmente l'AI Act (Regolamento UE 2024/1689), che ha stabilito a livello europeo un approccio basato sul rischio (risk-based approach). Tuttavia, mentre il Regolamento UE fornisce la cornice generale e i requisiti di sicurezza del prodotto, il legislatore italiano ha sentito l'urgenza di intervenire specificamente sulle dinamiche lavorative, ambito in cui l'asimmetria di potere tra datore di lavoro e dipendente rischia di essere esacerbata dall'uso opaco degli algoritmi.

La Legge 132/2025, entrata in vigore il 10 ottobre 2025, rappresenta la prima legge quadro organica in materia. Essa non si limita a recepire le direttive europee, ma le integra con i principi costituzionali italiani, in particolare l'articolo 41 (libertà di iniziativa economica, che non può svolgersi in contrasto con l'utilità sociale o in modo da recare danno alla sicurezza, alla libertà, alla dignità umana) e l'articolo 4 (diritto al lavoro). La legge delega il Governo ad adottare misure specifiche per la formazione, la tutela dei lavoratori e la definizione di sanzioni, creando un'architettura normativa dinamica capace di adattarsi all'evoluzione tecnologica.

Un elemento di particolare rilievo è la continuità con il Decreto Trasparenza (D.Lgs. 104/2022), che aveva già introdotto obblighi informativi sui sistemi automatizzati. La Legge 132/2025 e il successivo Decreto Ministeriale 180/2025 potenziano questi obblighi, trasformando la trasparenza da adempimento burocratico a diritto soggettivo del lavoratore alla "spiegabilità" delle decisioni che lo riguardano.

Analisi Strutturale della Legge 132/2025

La Legge 132/2025 si articola in diversi capi che affrontano aspetti eterogenei, dalla ricerca scientifica alla sanità, ma è nel "Capo II - Disposizioni in materia di lavoro" che si concentrano le novità più dirompenti per le imprese.

Principi Cardine (Artt. 1-5)

La legge stabilisce che l'uso dell'IA deve essere improntato a principi di:

- Giustizia ed Equità: Divieto di discriminazione algoritmica.

- Trasparenza: Obbligo di rendere intellegibili i meccanismi decisionali.

- Sicurezza: Garanzia che i sistemi siano robusti e resilienti agli attacchi.

- Sostenibilità: Attenzione all'impatto sociale e ambientale.

Il legislatore ha voluto sottolineare che l'introduzione dell'IA deve avvenire "nel rispetto dei diritti fondamentali", un richiamo che in sede giudiziaria permetterà ai magistrati di valutare la legittimità degli algoritmi non solo sulla base della loro correttezza tecnica, ma della loro compatibilità con la dignità del lavoratore.

L'Articolo 10 e la Gestione del Rapporto di Lavoro

L'articolo 10 della legge pone divieti espliciti sull'uso dell'IA per pratiche di "sorveglianza indiscriminata". Sebbene il controllo a distanza sia disciplinato dall'articolo 4 dello Statuto dei Lavoratori, la nuova norma chiarisce che l'IA non può essere utilizzata per inferire dati sensibili (come opinioni politiche, stato emotivo, salute) attraverso l'analisi biometrica o comportamentale, salvo casi eccezionali e strettamente regolamentati.

Il Decreto Ministeriale n. 180 del 17 Dicembre 2025

Il vero snodo operativo della riforma è costituito dal Decreto Ministeriale n. 180 del 17 dicembre 2025. È fondamentale chiarire un punto che ha generato confusione nelle prime fasi di divulgazione: alcune fonti giornalistiche e bozze preliminari facevano riferimento a un "Decreto 170" o "177". Tuttavia, la pubblicazione ufficiale sul sito del Ministero del Lavoro e delle Politiche Sociali conferma inequivocabilmente che il provvedimento definitivo reca il numero 180.

Questo decreto adotta le "Linee guida per l'implementazione dell'Intelligenza Artificiale nel mondo del lavoro", un documento tecnico-politico che detta la roadmap per le aziende. Non si tratta di mere raccomandazioni (soft law), ma di parametri che l'Ispettorato Nazionale del Lavoro utilizzerà per verificare la conformità aziendale. Le Linee Guida sono state elaborate a seguito di una consultazione pubblica che ha coinvolto parti sociali, esperti e associazioni di categoria, garantendo un approccio bilanciato tra le esigenze di produttività delle imprese e le tutele dei lavoratori.

Le Linee Guida Operative - Una Roadmap per le Imprese

Le Linee Guida ministeriali sono strutturate per accompagnare le organizzazioni, con un focus particolare sulle Piccole e Medie Imprese (PMI), attraverso un percorso di adozione consapevole. L'obiettivo dichiarato è evitare che l'IA diventi un fattore di esclusione o di precarizzazione.

I Tre Pilastri Strategici

Il Ministero ha individuato tre macro-aree di intervento, che devono guidare ogni progetto di implementazione IA in azienda:

- Formazione e Sviluppo delle Competenze (Upskilling & Reskilling):

L'automazione non deve tradursi in licenziamenti tecnologici, ma in una riqualificazione della forza lavoro. Le linee guida prevedono che ogni introduzione di sistemi IA sia accompagnata da piani formativi specifici. Non basta insegnare al dipendente "come cliccare", ma bisogna fornire una AI Literacy (alfabetizzazione all'IA) che gli permetta di comprendere i limiti e i rischi dello strumento che utilizza. - Tutela dei Diritti e Supervisione Umana:

Viene ribadito il principio dello Human-in-command. In nessun caso una decisione che impatta significativamente sulla vita lavorativa (assunzione, sanzione, licenziamento, promozione, trasferimento) può essere delegata interamente alla macchina. L'ultima parola deve spettare a un essere umano, che deve avere non solo l'autorità formale, ma anche la competenza tecnica per contestare o sovrascrivere l'output algoritmico. - Inclusione e Riduzione del Divario Digitale:

Le linee guida pongono l'accento sulla necessità di democratizzare l'accesso all'IA, evitando che si crei un divario incolmabile tra grandi corporation e PMI, o tra Nord e Sud del Paese. Vengono previsti incentivi specifici per le imprese del Mezzogiorno e per le realtà artigianali, affinché l'IA sia un volano di coesione territoriale.

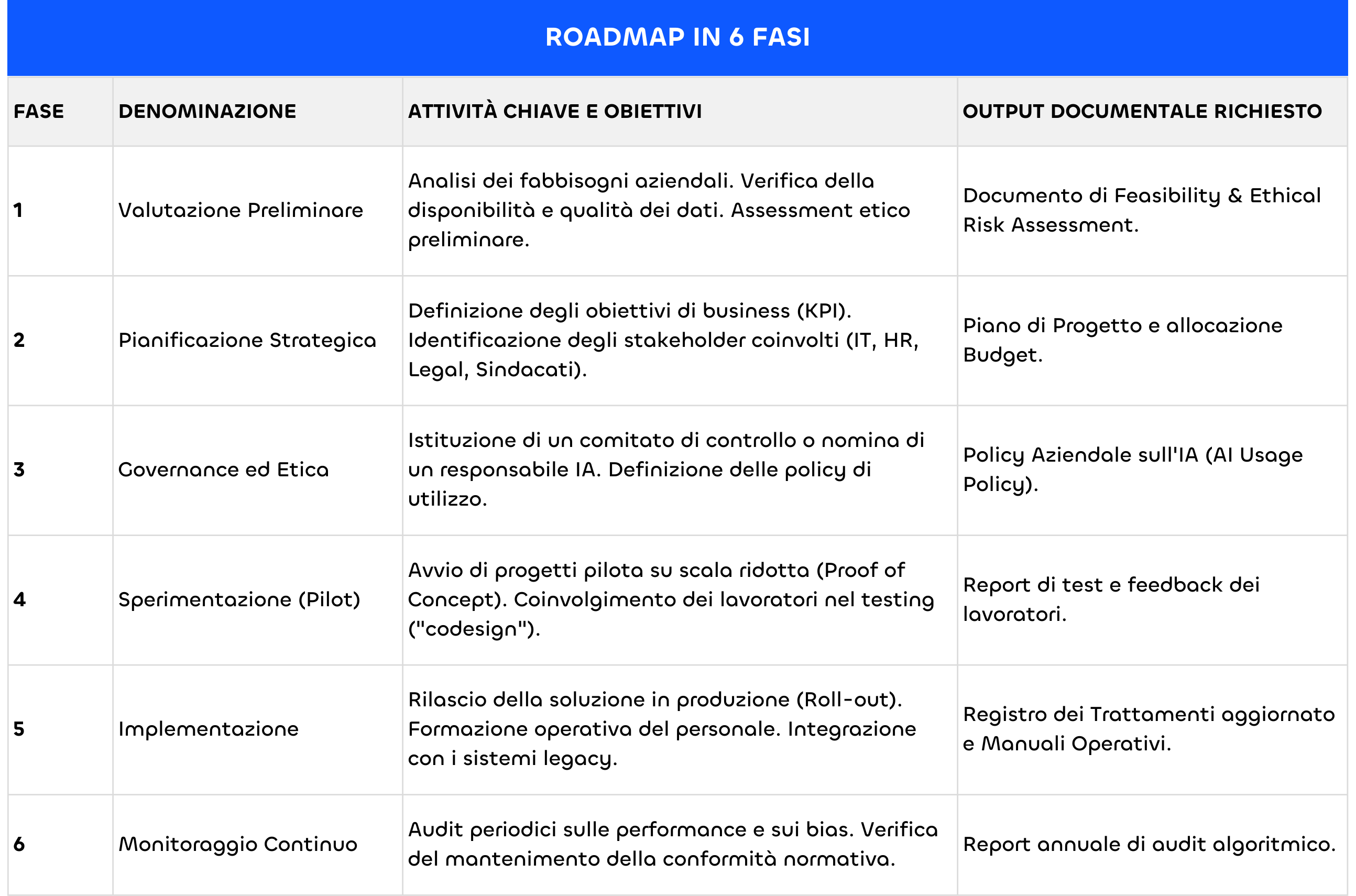

La Roadmap in Sei Fasi

Per trasformare i principi in prassi, il documento ministeriale propone una metodologia procedurale articolata in sei fasi, che le aziende sono invitate a seguire e documentare:

Questa struttura non è solo un suggerimento gestionale; in caso di contenzioso, dimostrare di aver seguito questo iter procedurale costituisce una prova fondamentale della buona fede e della diligenza dell'azienda (accountability).

Strumenti di Supporto: Centri di Competenza e Marketplace

Consapevole che le PMI non dispongono delle risorse delle grandi multinazionali, il Decreto 180/2025 istituisce infrastrutture di supporto concrete :

- Marketplace IA: Una piattaforma digitale certificata dove le PMI possono trovare soluzioni IA "chiavi in mano", verificate per la conformità alle norme italiane.

- Centri di Competenza: Poli territoriali, spesso legati alle Università o ai Digital Innovation Hub, che offrono consulenza tecnica, legale e formazione finanziata. Questi centri agiscono come intermediari di fiducia, abbattendo le barriere all'ingresso.

Obblighi di Trasparenza e Relazioni Industriali

L'aspetto più critico e immediato per i Dipartimenti HR riguarda i nuovi obblighi di informazione e consultazione. La Legge 132/2025 modifica sostanzialmente le relazioni industriali, introducendo un livello di trasparenza senza precedenti.

L'Informativa Rafforzata e il Preavviso di 24 Ore

L'articolo 11 della Legge 132/2025, che integra e modifica il D.Lgs. 152/1997 (Decreto Trasparenza), introduce un obbligo perentorio: il datore di lavoro o il committente deve informare il lavoratore dell'utilizzo di sistemi decisionali o di monitoraggio automatizzati.

La novità dirompente risiede nella tempistica e nel contenuto:

- Tempistica: L'informativa deve essere fornita per iscritto almeno 24 ore prima dell'inizio dell'utilizzo del sistema o di una sua modifica sostanziale. Questo "periodo di raffreddamento" serve a garantire che il lavoratore abbia il tempo di comprendere le implicazioni dello strumento.

- Contenuto: Non è sufficiente una comunicazione generica. L'informativa deve dettagliare:

- Gli aspetti del rapporto di lavoro influenzati dal sistema (es. assegnazione turni, calcolo premi).

- Gli scopi e le finalità del sistema.

- La logica di funzionamento: questo è il punto più complesso. Bisogna spiegare in termini comprensibili quali parametri (input) vengono usati e come l'algoritmo li elabora per produrre un risultato (output).

- Le categorie di dati trattati.

- Le misure di sicurezza e controllo umano (chi supervisiona l'algoritmo?).

Il Ruolo delle Rappresentanze Sindacali

Le Linee Guida e la Legge 132/2025 rafforzano il ruolo delle parti sociali. L'introduzione di sistemi di IA che possono impattare sull'organizzazione del lavoro o sul controllo a distanza richiede il coinvolgimento preventivo delle Rappresentanze Sindacali Unitarie (RSU) o Aziendali (RSA).

In assenza di accordo sindacale, l'azienda deve richiedere l'autorizzazione all'Ispettorato Territoriale del Lavoro, come previsto dall'art. 4 dello Statuto dei Lavoratori. L'IA non deregolamenta il controllo a distanza; al contrario, ne amplia la potenziale pervasività, rendendo le tutele statutarie ancora più necessarie. Il sindacato acquisisce inoltre il diritto di accedere alle informazioni tecniche sui sistemi utilizzati, potendosi avvalere di propri esperti per verificare la "neutralità" degli algoritmi.

Bias Cognitivi e Discriminazione Algoritmica

Le Linee Guida pongono grande enfasi sul rischio di discriminazione indiretta. Un algoritmo di recruiting addestrato su dati storici potrebbe, ad esempio, penalizzare le donne o le minoranze etniche semplicemente perché "ha imparato" che in passato quei profili venivano assunti meno frequentemente.

Le aziende hanno l'obbligo di:

- Verificare i Dataset: Assicurarsi che i dati di addestramento siano rappresentativi e depurati da pregiudizi (data cleaning).

- Monitorare gli Output: Analizzare statisticamente le decisioni dell'IA per intercettare eventuali deviazioni discriminatorie (disparate impact).

- Implementare Correttivi: Modificare i pesi dell'algoritmo o intervenire manualmente se si rilevano bias.

Privacy, Data Protection e GDPR nell'Era dell'IA

L'intersezione tra la nuova normativa IA e il GDPR (Regolamento UE 2016/679) è l'area che presenta le maggiori sfide tecniche e legali. I dati sono il carburante dell'IA, ma quando questi dati riguardano i lavoratori, le tutele devono essere massime.

La Valutazione d'Impatto (DPIA) come Presupposto Indefettibile

L'articolo 35 del GDPR prevede l'obbligo di effettuare una Valutazione d'Impatto sulla Protezione dei Dati (DPIA) quando un trattamento prevede l'uso di nuove tecnologie e presenta un rischio elevato. Le Linee Guida Ministeriali e i provvedimenti del Garante Privacy chiariscono che l'impiego di sistemi di IA nel contesto lavorativo ricade sempre in questa casistica.

La DPIA non è un documento statico da archiviare, ma un processo dinamico che deve:

- Descrivere sistematicamente il trattamento (algoritmi usati, flussi di dati).

- Valutare la necessità e la proporzionalità (l'IA è davvero necessaria per raggiungere lo scopo?).

- Analizzare i rischi per i diritti e le libertà (rischio di discriminazione, rischio di sorveglianza indebita, rischio di errori non rilevati).

- Individuare le misure di mitigazione (pseudonimizzazione, cifratura, limitazione della conservazione).

Gestione dei Dati Biometrici ed Emozionali

La Legge 132/2025 (in armonia con l'AI Act europeo) pone restrizioni severissime sull'uso di sistemi di categorizzazione biometrica e di riconoscimento delle emozioni sul luogo di lavoro.

L'utilizzo di telecamere intelligenti che analizzano l'attenzione del lavoratore (es. driver monitoring systems) o software che valutano lo stress dalla voce durante una chiamata di customer service è, in linea di principio, vietato o consentito solo in casi eccezionali legati alla sicurezza fisica, e mai per finalità disciplinari o di valutazione della performance.

Il Garante Privacy ha più volte ribadito 10 che il consenso del lavoratore, in questi casi, non è una base giuridica valida a causa dello squilibrio di potere contrattuale: il dipendente non è mai veramente "libero" di negare il consenso al proprio datore di lavoro.

Il Diritto alla Spiegazione e l'Articolo 22 GDPR

L'articolo 22 del GDPR conferisce all'interessato il diritto di non essere sottoposto a decisioni basate unicamente sul trattamento automatizzato. La normativa italiana rafforza questo diritto, imponendo che la spiegazione fornita al lavoratore sia "significativa".

Questo crea una sfida tecnica enorme per i sistemi di Deep Learning (reti neurali profonde), spesso definiti "Black Box" perché nemmeno i loro sviluppatori sanno spiegare esattamente perché la rete ha preso una certa decisione.

Le aziende devono quindi orientarsi verso soluzioni di Explainable AI (XAI), ovvero sistemi progettati per rendere trasparenti i propri processi decisionali, o mantenere un livello di supervisione umana tale da poter ricondurre la decisione finale a un ragionamento logico umano e non solo statistico.

Analisi Settoriale e Scenari Applicativi

L'impatto delle Linee Guida varia drasticamente a seconda del settore merceologico. Di seguito si analizzano le implicazioni specifiche per alcuni comparti chiave dell'economia italiana.

Manifatturiero e Industria 4.0 (Robotica Collaborativa)

Nel settore manifatturiero, l'IA si manifesta spesso sotto forma di robot collaborativi (cobots) e sistemi di manutenzione predittiva.

- Opportunità: Riduzione degli infortuni, miglioramento dell'ergonomia, ottimizzazione dei turni.

- Rischi e Compliance: I sistemi di visione artificiale usati per la sicurezza non devono trasformarsi in strumenti di controllo dei tempi di pausa. L'informativa deve chiarire che i dati raccolti servono solo per la sicurezza della macchina e non per valutare la velocità dell'operatore.

- Formazione: Necessità di formare gli operai all'interazione fisica e logica con le macchine intelligenti.

Gig Economy e Logistica (Gestione Algoritmica)

È il settore più "caldo" dal punto di vista giuslavoristico. Piattaforme di delivery e logistica usano algoritmi per assegnare compiti e calcolare percorsi.

- Implicazioni Legge 132/2025: L'algoritmo non può decidere autonomamente di disconnettere un rider (licenziamento di fatto) basandosi su un ranking opaco. Deve esserci una procedura di revisione umana.

- Trasparenza: I lavoratori devono conoscere i criteri con cui vengono assegnate le consegne più redditizie. La mancanza di trasparenza in questo ambito è sanzionabile come pratica discriminatoria.

Servizi Finanziari e Assicurativi (White Collar)

Qui l'IA è usata per l'analisi dei dati, il trading algoritmico e la valutazione del rischio.

- Rischio di Performance Monitoring: Software che monitorano l'attività del dipendente al PC (keystroke logging, analisi delle email) per valutare la produttività sono ad altissimo rischio di violazione dell'art. 4 Statuto Lavoratori.

- Recruiting: L'uso di IA per scremare i CV deve essere attentamente monitorato per evitare bias di genere o di provenienza universitaria che potrebbero escludere talenti validi.

Professioni Intellettuali (Avvocati, Commercialisti, Giornalisti)

L'art. 13 della Legge 132/2025 tocca specificamente le professioni intellettuali.

- Principio di Strumentalità: L'IA deve essere uno strumento di supporto, non un sostituto. La responsabilità della prestazione professionale (es. un parere legale, una diagnosi medica) rimane interamente in capo al professionista iscritto all'albo.

- Obbligo Informativo verso il Cliente: Il professionista deve informare il cliente se utilizza sistemi di IA generativa per produrre documenti o analisi, garantendo trasparenza sull'origine del lavoro intellettuale.

L'Osservatorio Nazionale e il Futuro del Lavoro

La riforma non si esaurisce con l'entrata in vigore della legge, ma prevede un meccanismo di monitoraggio permanente. L'articolo 12 della Legge 132/2025 istituisce presso il Ministero del Lavoro l'Osservatorio sull'adozione di sistemi di intelligenza artificiale nel mondo del lavoro.

Funzioni Strategiche dell'Osservatorio

L'Osservatorio non è un mero centro studi, ma un organo con poteri consultivi e di indirizzo:

- Monitoraggio del Mercato: Analizzare quali competenze diventano obsolete e quali emergono, per orientare i programmi scolastici e universitari.

- Revisione delle Linee Guida: La tecnologia corre più veloce della legge. L'Osservatorio ha il compito di proporre aggiornamenti periodici al Decreto 180/2025 per coprire nuove tecnologie (es. Agenti IA autonomi, Quantum Computing).

- Valutazione dell'Impatto Etico: Raccogliere segnalazioni su usi distorti dell'IA e proporre correttivi legislativi.

Scenari Futuri (2026-2030)

L'analisi prospettica suggerisce che l'adeguamento alla normativa sarà un driver di selezione competitiva. Le aziende che vedranno la compliance come un mero costo burocratico rischieranno di rimanere indietro. Al contrario, quelle che useranno la "trasparenza algoritmica" come leva di Employer Branding attireranno i migliori talenti.

Nel medio termine, ci si attende una convergenza sempre più stretta tra normativa sulla sicurezza sul lavoro (D.Lgs. 81/08) e normativa IA: lo "stress da algoritmo" e il burnout digitale diventeranno rischi valutabili nel Documento di Valutazione dei Rischi (DVR).

Checklist Operativa di Adeguamento

Per supportare le aziende nella transizione, si propone una checklist operativa di sintesi, derivata dall'analisi incrociata del Decreto 180/2025, della Legge 132/2025 e delle best practice di compliance.

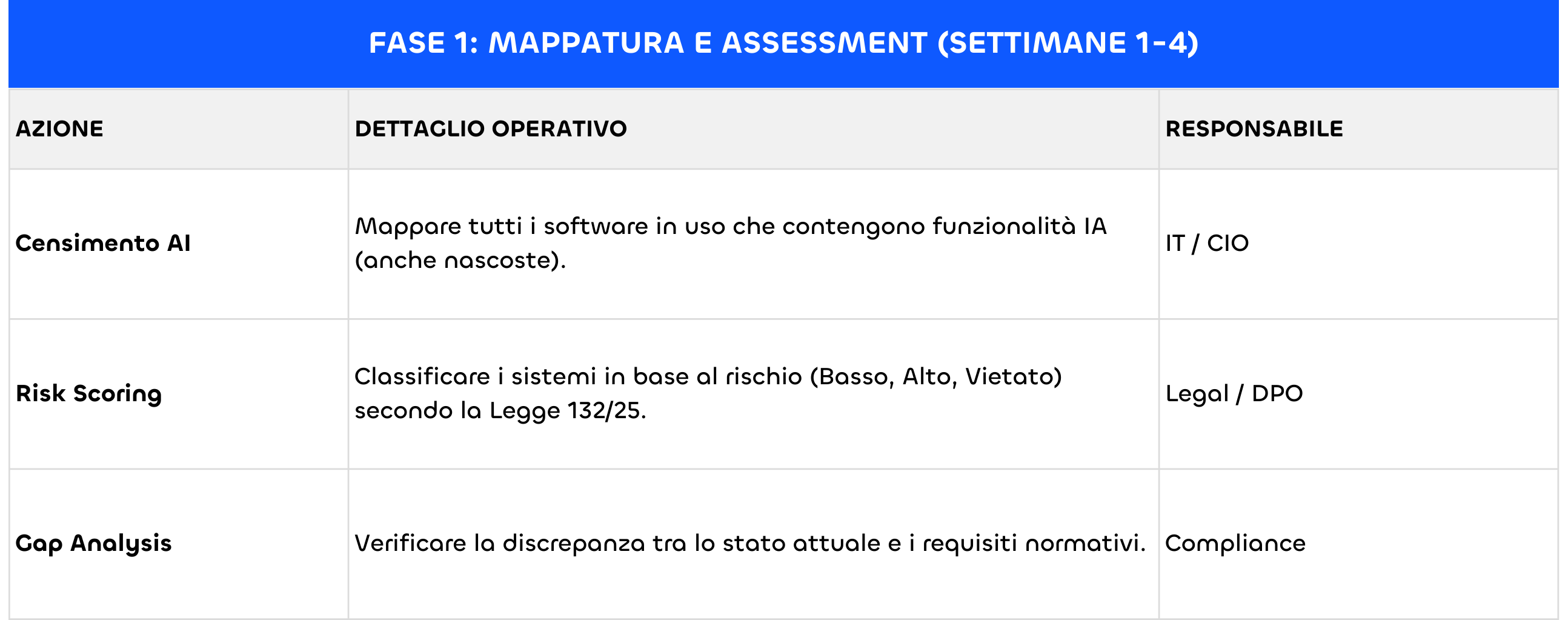

Fase 1: Mappatura e Assessment (Settimane 1-4)

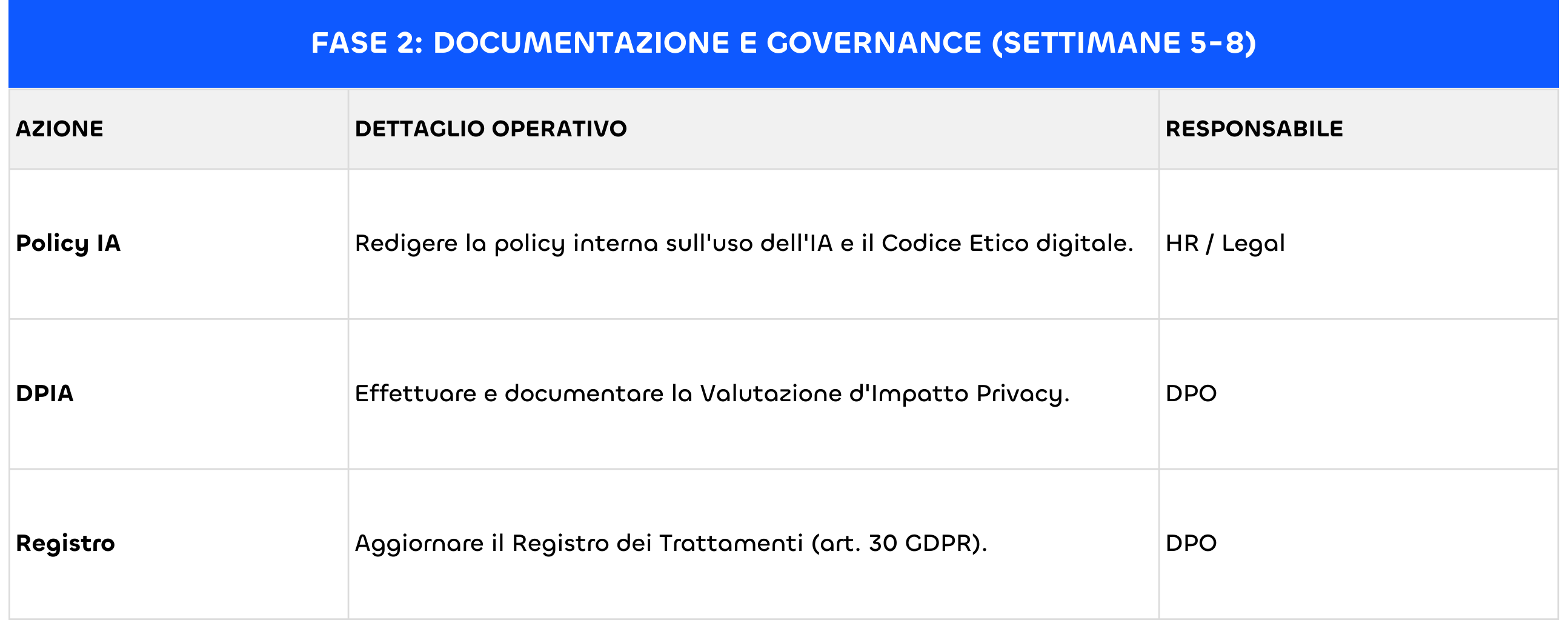

Fase 2: Documentazione e Governance (Settimane 5-8)

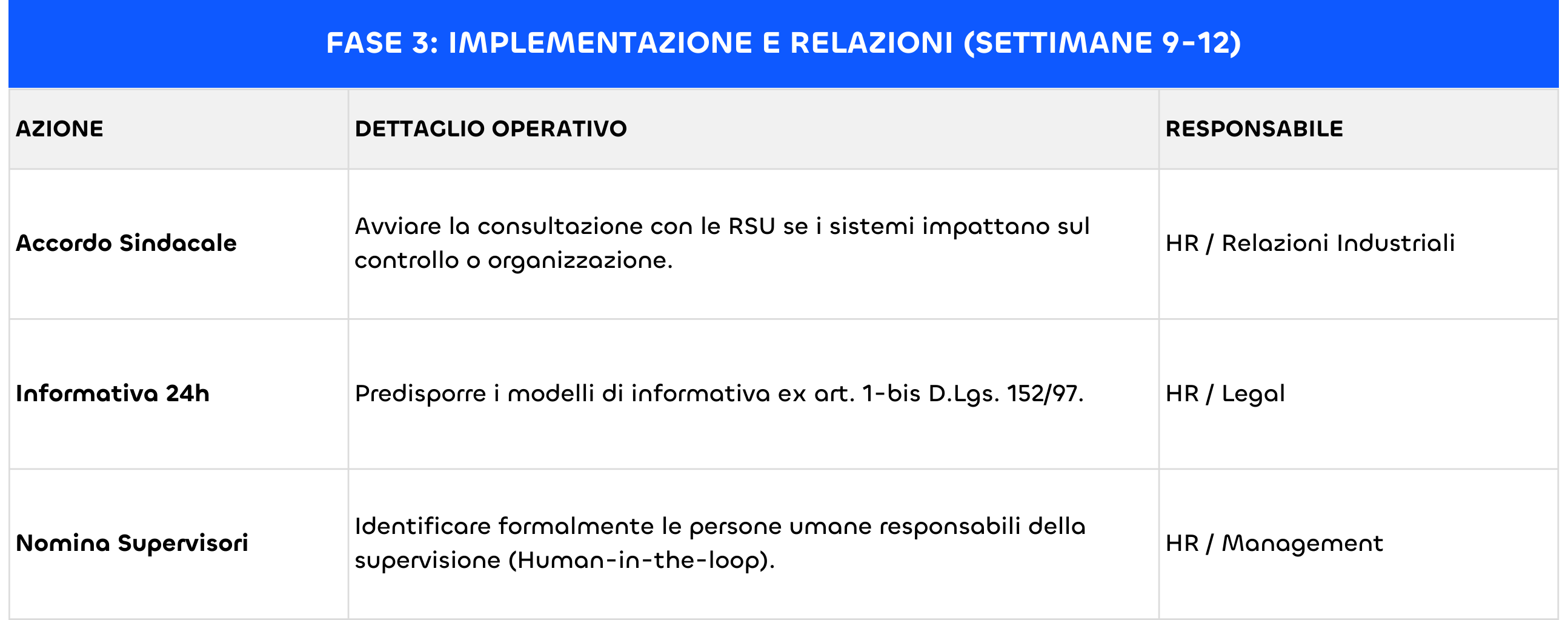

Fase 3: Implementazione e Relazioni (Settimane 9-12)

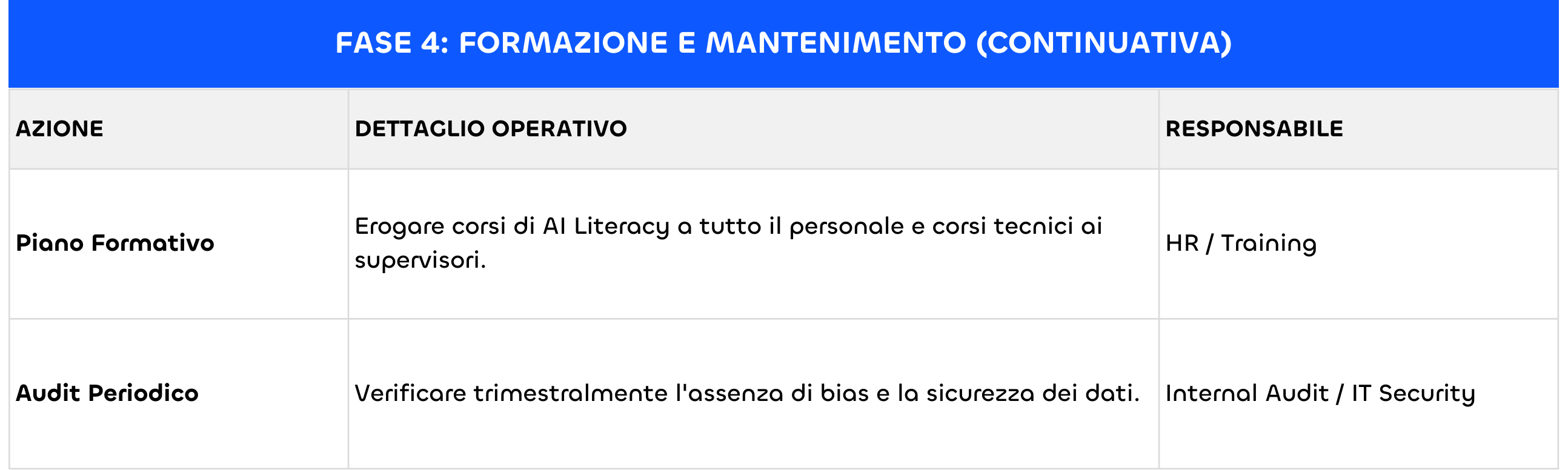

Fase 4: Formazione e Mantenimento (Continuativa)

Il Decreto Ministeriale 180/2025 e la Legge 132/2025 segnano la fine del "Far West" digitale nel mercato del lavoro italiano. L'approccio del legislatore è chiaro: l'innovazione tecnologica è un valore costituzionale, ma non può diventare un tiranno. La regolamentazione non mira a frenare l'IA, ma a incanalarla verso un modello di sviluppo sostenibile, dove la produttività aumenta grazie alla collaborazione uomo-macchina e non grazie allo sfruttamento algoritmico.

Per i professionisti del settore, la sfida è culturale prima che legale. Significa passare da una logica di "controllo del dipendente" a una di "empowerment del dipendente tramite la tecnologia". Le aziende che sapranno interpretare questo cambio di paradigma non solo eviteranno pesanti sanzioni (che possono arrivare fino al 7% del fatturato globale in caso di violazioni gravi dell'AI Act combinato con il GDPR), ma costruiranno organizzazioni più resilienti, etiche e attrattive.

L'era dell'IA nel lavoro è iniziata. Ora è il momento di governarla.